СПЕЦИАЛИЗИРОВАННЫЕ АЛГОРИТМЫ ОБУЧЕНИЯ И НАСТРОЙКИ РЕКУРРЕНТНОЙ СЕТИ ПРЕОБРАЗОВАТЕЛЯ ЧАСТОТНО-ВРЕМЕННЫХ ПАРАМЕТРОВ СИГНАЛОВ В КОД

Одним из направлений повышения эффективности преобразователей формы представления информации (ПФИ) аналоговой величины x (заданной в виде частоты f x или временного интервала ) в цифровой эквивалент в информационно-измерительных системах является расширение функциональных (интеллектуальных) возможностей ПФИ, в том числе с использованием математического аппарата искусственных нейронных сетей (ИНС) [1].

Предложенная в [1] методика синтеза нейросетевых преобразователей содержит 4 этапа. Наиболее трудоемким из них является настройка нейросетевых ПФИ на решение задачи преобразования. Под настройкой ИНС-преобразователя понимается совокупность специальных процедур, таких как, выбор алгоритма обучения нейросети и обучающих примеров, а также собственно процедуры обучения и тестирования устройства на решение поставленной задачи преобразования [1].

При разработке аппаратно-реализуемых нейросетевых устройств преобразования существует задача разработки специализированных алгоритмов обучения нейронных сетей [1], так как универсальные нейросетевые структуры и алгоритмы их обучения рассчитаны, как правило, на программную реализацию, что не всегда приемлемо в устройствах, функционирующих независимо от вычислительного центра управления системой сбора и обработки информации.

Из работы [2] известна структура нейросетевого преобразователя частотно-временных параметров x сигналов в цифровой код на основе последовательного соединения двух компонент: однослойной ИНС и двухслойной рекуррентной сети. Последняя обладает рядом недостатков.

- Неопределенность минимального необходимого количества нейронов скрытого слоя сети для выполнения поставленной задачи преобразования.

- Структура рассчитана на обучение с помощью алгоритма обратного распространения ошибки, сходимость которого зависит от многих факторов (вид функции активации нейронов, способность алгоритма обойти «локальные минимумы» и др.), что не всегда возможно учесть заранее в аппаратно-реализуемом устройстве.

В связи с этим предлагается модификация второй компоненты структуры нейросетевого преобразователя частотно-временных параметров x сигналов в цифровой код на основе двухслойной рекуррентной сети с целью устранения выше перечисленных недостатков.

Первая компонента осуществляет преобразование аналоговой величины x, представленной в виде частоты f x или временного интервала , в число-импульсный код относительно опopной величины , представленной в виде временного интервала , частоты f 0 или периода T 0.

Математически работу нейрона первой компоненты ИНС (см. рис. 2) можно описать следующей формулой [2]:

где - значения суммы на входе порогового элемента нейрона в дискретные моменты времени (такт) , h - номер такта преобразования длительностью T 0. Аналоговая величина x задает значение переменного порога нейрона. Код на выходе первой компоненты представляется в виде последовательности импульсов α 0:

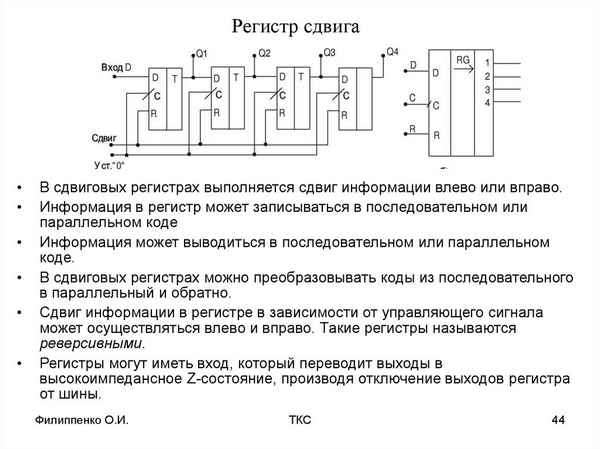

Модифицированная вторая компонента может осуществлять преобразование унитарного число-импульсного кода в двоично-позиционный код в зависимости от значений весовых коэффициентов и порогов нейронов сети. Входом для импульсов α0 является сдвиговый регистр, состоящий из элементов задержки ЭЗ1, ЭЗ2,.. и т.д. Биты элементов задержки сдвигового регистра совместно с битами элементов задержки обратных связей ЭЗБ1, ЭЗБ2,.. и т.д. являются входами двухслойной рекуррентной сети.

Условно двухслойную сеть можно разбить на группы нейронов, формирующие соответствующие им биты β1 позиционного кода , и группу нейронов формирующих сигнал сброса Clr сдвигового регистра. Каждая из этих групп образует двухслойную рекуррентную подсеть с обратной связью, которая состоит из группы нейронов первого слоя и одного нейрона второго (выходного) слоя. Нейроны имеют пороговую функцию активации:

где - взвешенная сумма значений входов нейрона x j; M - число входов нейрона; W j,i - весовые коэффициенты нейрона; θ i - порог нейрона.

Предлагаемый алгоритм содержит 3 этапа.

- Формирование обучающей выборки.

- Формирование структуры сети.

- Обучение нейронов сформированной сети.

Приведенный специализированный алгоритм обучения и настройки нейросетевых преобразователей позволяет проектировать преобразователи формы информации на основе модифицированной рекуррентной сети на задачу нелинейного преобразования «аналог-код», не прибегая к стандартным обучающим алгоритмам при настройке и (или) перенастройке функционального преобразователя на реализацию новой функции преобразования. Это исключает итеративное приближение весовых коэффициентов к искомым значениям, что существенно сокращает время настройки. Предложенные этапы обучения учитывают структурные особенности слоев рекуррентной сети, что снижает аппаратные затраты на реализацию весовых коэффициентов второго слоя, в отличие от стандартных алгоритмов обучения сетей, рассчитанных в основном на программную реализацию.

СПИСОК ЛИТЕРАТУРЫ

- Локтюхин В.Н., Челебаев С.В. Нейросетевые преобразователи импульсно-аналоговой информации: организация, синтез, реализация / Под общей редакцией А.И. Галушкина. - М.: Горячая линия - Телеком, 2008. ‑ 144 с.

- Локтюхин В.Н., Челебаев С.В. Применение рекуррентных сетей для синтеза импульсно-цифровых преобразователей // Вестник Рязанского государственного радиотехнического университета, № 19, 2006. С. 94-103.

Статья в формате PDF

138 KB...

Статья в формате PDF

138 KB...

28 04 2024 10:52:24

26 04 2024 0:39:55

В работе приведены результаты анализа степеней сингемеробии парциальных флор Якутии в разрезе флористических районов. Отмечается роль географических факторов в формировании групп районов, объединенных по степени сингемеробии флор крупных геоботанических типов.

...

В работе приведены результаты анализа степеней сингемеробии парциальных флор Якутии в разрезе флористических районов. Отмечается роль географических факторов в формировании групп районов, объединенных по степени сингемеробии флор крупных геоботанических типов.

...

25 04 2024 3:21:30

Статья в формате PDF

153 KB...

Статья в формате PDF

153 KB...

23 04 2024 18:19:25

Статья в формате PDF

145 KB...

Статья в формате PDF

145 KB...

22 04 2024 5:40:39

Статья в формате PDF

104 KB...

Статья в формате PDF

104 KB...

21 04 2024 12:32:33

Статья в формате PDF

244 KB...

Статья в формате PDF

244 KB...

20 04 2024 17:59:44

Статья в формате PDF

107 KB...

Статья в формате PDF

107 KB...

19 04 2024 4:12:19

Статья в формате PDF

112 KB...

Статья в формате PDF

112 KB...

18 04 2024 20:43:10

Статья в формате PDF

352 KB...

Статья в формате PDF

352 KB...

17 04 2024 8:38:26

16 04 2024 0:18:42

Статья в формате PDF

115 KB...

Статья в формате PDF

115 KB...

15 04 2024 17:53:50

Статья в формате PDF

346 KB...

Статья в формате PDF

346 KB...

14 04 2024 4:46:50

Статья в формате PDF

329 KB...

Статья в формате PDF

329 KB...

13 04 2024 19:51:36

Статья в формате PDF

133 KB...

Статья в формате PDF

133 KB...

12 04 2024 20:24:50

Статья в формате PDF

126 KB...

Статья в формате PDF

126 KB...

10 04 2024 3:56:29

Статья в формате PDF

237 KB...

Статья в формате PDF

237 KB...

09 04 2024 15:54:17

Статья в формате PDF

112 KB...

Статья в формате PDF

112 KB...

08 04 2024 7:48:42

Статья в формате PDF

132 KB...

Статья в формате PDF

132 KB...

07 04 2024 11:38:35

Статья в формате PDF

132 KB...

Статья в формате PDF

132 KB...

05 04 2024 16:10:29

Статья в формате PDF

140 KB...

Статья в формате PDF

140 KB...

04 04 2024 14:58:13

Статья в формате PDF

138 KB...

Статья в формате PDF

138 KB...

03 04 2024 15:42:54

Статья в формате PDF

137 KB...

Статья в формате PDF

137 KB...

02 04 2024 5:38:20

Статья в формате PDF

118 KB...

Статья в формате PDF

118 KB...

30 03 2024 13:30:10

29 03 2024 9:24:13

Статья в формате PDF

130 KB...

Статья в формате PDF

130 KB...

28 03 2024 7:58:21

Статья в формате PDF

213 KB...

Статья в формате PDF

213 KB...

27 03 2024 0:20:34

В настоящее время одной из наиболее обсуждаемых является тема воздействия интеллигенции на общественно-экономическую жизнь. Интеллигенция, являясь наиболее образованной группой общества, является монополистом в области на духовного и интеллектуального производства. По мере ускорения научно-технического прогресса данная тенденция усиливается.

...

В настоящее время одной из наиболее обсуждаемых является тема воздействия интеллигенции на общественно-экономическую жизнь. Интеллигенция, являясь наиболее образованной группой общества, является монополистом в области на духовного и интеллектуального производства. По мере ускорения научно-технического прогресса данная тенденция усиливается.

...

26 03 2024 3:26:59

Статья в формате PDF

113 KB...

Статья в формате PDF

113 KB...

25 03 2024 0:50:23

Статья в формате PDF

127 KB...

Статья в формате PDF

127 KB...

24 03 2024 14:55:44

23 03 2024 15:23:20

Статья в формате PDF

111 KB...

Статья в формате PDF

111 KB...

22 03 2024 20:28:13

Статья в формате PDF

120 KB...

Статья в формате PDF

120 KB...

21 03 2024 12:30:52

Статья в формате PDF

320 KB...

Статья в формате PDF

320 KB...

20 03 2024 5:47:20

Еще:

Поддержать себя -1 :: Поддержать себя -2 :: Поддержать себя -3 :: Поддержать себя -4 :: Поддержать себя -5 :: Поддержать себя -6 :: Поддержать себя -7 :: Поддержать себя -8 :: Поддержать себя -9 :: Поддержать себя -10 :: Поддержать себя -11 :: Поддержать себя -12 :: Поддержать себя -13 :: Поддержать себя -14 :: Поддержать себя -15 :: Поддержать себя -16 :: Поддержать себя -17 :: Поддержать себя -18 :: Поддержать себя -19 :: Поддержать себя -20 :: Поддержать себя -21 :: Поддержать себя -22 :: Поддержать себя -23 :: Поддержать себя -24 :: Поддержать себя -25 :: Поддержать себя -26 :: Поддержать себя -27 :: Поддержать себя -28 :: Поддержать себя -29 :: Поддержать себя -30 :: Поддержать себя -31 :: Поддержать себя -32 :: Поддержать себя -33 :: Поддержать себя -34 :: Поддержать себя -35 :: Поддержать себя -36 :: Поддержать себя -37 :: Поддержать себя -38 ::